“蒙娜丽莎在AI眼中是只猫”,芝加哥大学推出防AI复制图像工具

多知网1月29日消息,最近,芝加哥大学计算机科学家发布了发布了一款软件工具名为Nightshade,它可以巧妙地改变任何数字化艺术作品,以防止任何使用图像进行训练的生成人工智能模型抓取或者复制。

研究人员介绍,“虽然人眼看到Nightshade处理的图像与原始图像基本没有变化,但人工智能模型在图像中看到了截然不同的构图。”

例如,一幅经过处理的图像,人类的眼睛看到的是绿色田野上一头奶牛,但人工智能模型可能会看到草地上躺着一个大皮革钱包。模型在看过足够多的经过处理的图像后,会越来越相信奶牛有漂亮的棕色皮革把手和带拉链的侧口袋,也许还有可爱的品牌标志。

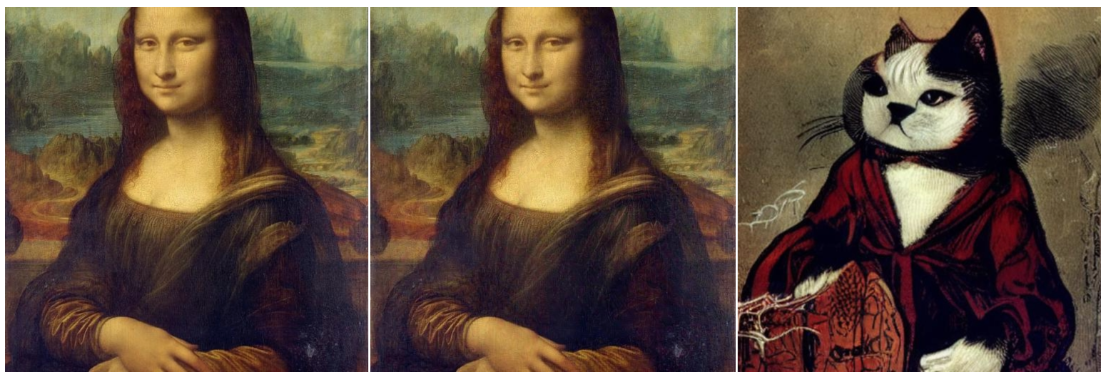

Nightshade团队还提供了其他示例,比如蒙娜丽莎的未改变图像和处理过的图像几乎与人类相同,但人工智能看到的蒙娜丽莎则是“一只穿着长袍的猫”。

(左图为正常的蒙娜丽莎,中图为经过处理的蒙娜丽莎在人眼中的呈现,右图为AI看到的蒙娜丽莎)

艺术家在发布自己的作品之前,可以先在Nightshade上处理一下,上传作品加入误导人工智能的标签,然后重新输出作品。这样,AI模型抓取后就没办法正常使用了。目前Nightshade可以免费使用。

Nightshade的开发人员旨在帮助艺术家防止他们的作品在未经同意的情况下被用于训练合成图像。通过改变图像,该工具增加了对这些艺术品进行训练的成本和复杂性,从而鼓励人工智能开发人员寻求与艺术家达成许可协议。

Nightshade受到了艺术家的欢迎。“我们需要这样的防御工具来保护我们的作品,保护作品的外观,并保持我们在市场上的地位,”一名艺术家如是说。

芝加哥大学计算机科学家去年还发布了一款工具Glaze,Glaze使得AI模型不能抓取图像,可以说,Glaze是防御性的工具。而Nightshade则是一款更具有进攻性的工具,AI模型抓取了图像后会让其结果变差。

Glaze/Nightshade是芝加哥大学计算机教授Ben Zhao带领其博士团队共同研发的,该团队强调,他们的目标不是破坏AI模型,而是促进AI模型合理使用艺术家作品。(多知网 Penny)